Искусственный интеллект (ИИ) стремительно меняет нашу жизнь, принося преимущества в экономике и упрощая работу во многих сферах. Однако вместе с возможностями он открывает и новые угрозы, среди которых технология deepfake вызывает особую тревогу. Как развивается ИИ и как защититься от цифровых мошенников, обсудили в программе "Алло, TV8".

"Технология deepfake, основанная на искусственном интеллекте, создает невероятно реалистичные, но фековые изображения и видео. Эти модели становятся всё более совершенными, и для их распознавания требуется все больше компетенций. Отличить реальное изображение от фальшивого становится всё сложнее", — отметила эксперт по ИИ Александра Чернян.

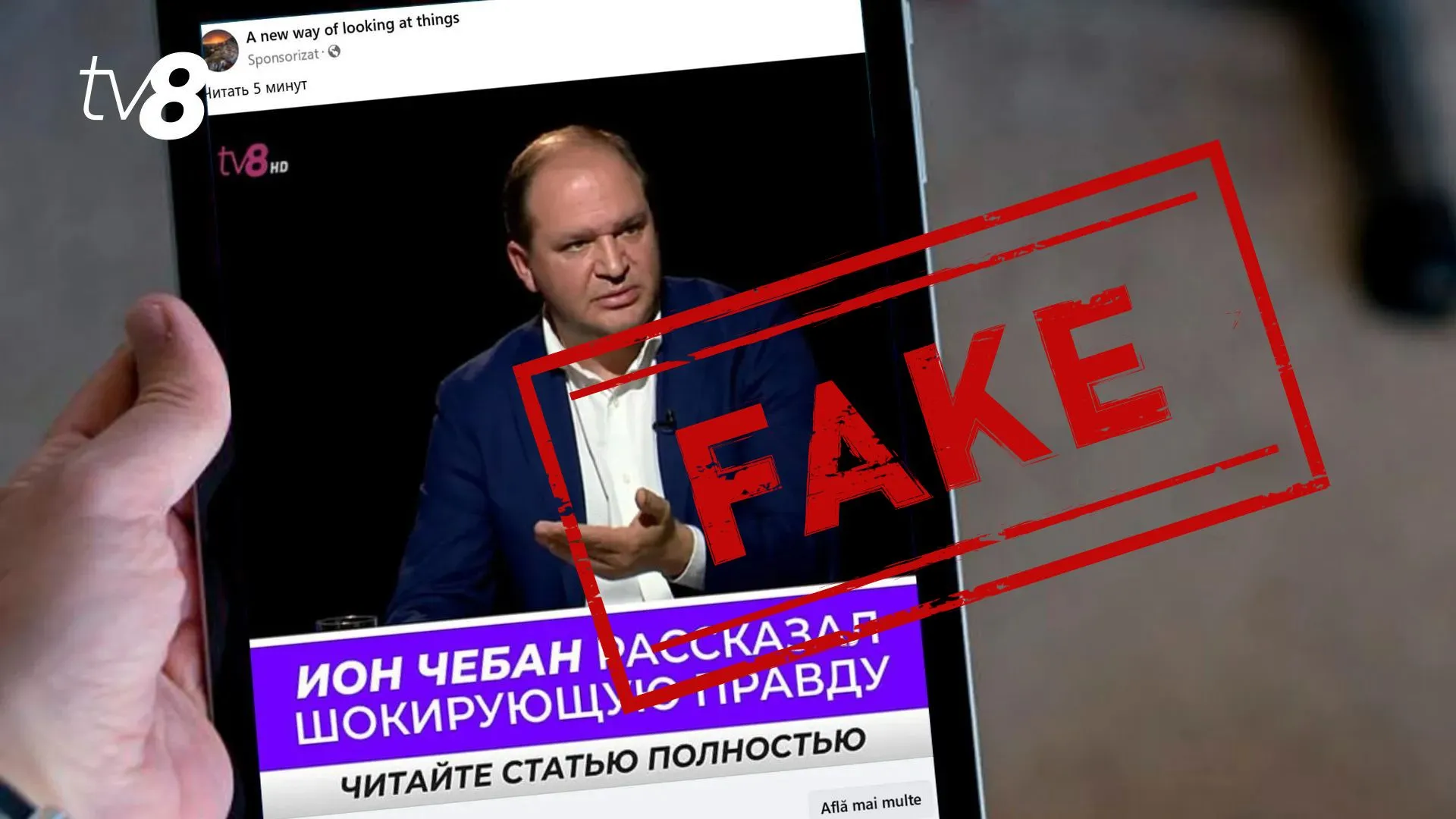

Некоторые создатели контента придерживаются этических норм, помечая deepfake-видео как пародию или развлекательный контент, а также плашкой "контент создан ИИ". Однако другие используют эту технологию для дезинформации, клеветы или мошенничества. В интернете можно встретить ролики, где знаменитости якобы рекламируют товары, которые никогда не использовали, или политики делают скандальные, но нехарактерные для них заявления.

Если несколько лет назад deepfake можно было распознать по неестественным движениям, странной мимике или искаженным чертам лица, то сегодня технология шагнула далеко вперед и "невооруженным глазом" понять что либо становится все сложнее. Современные фейки выглядят настолько реалистично, что это вызывает все больше тревоги.

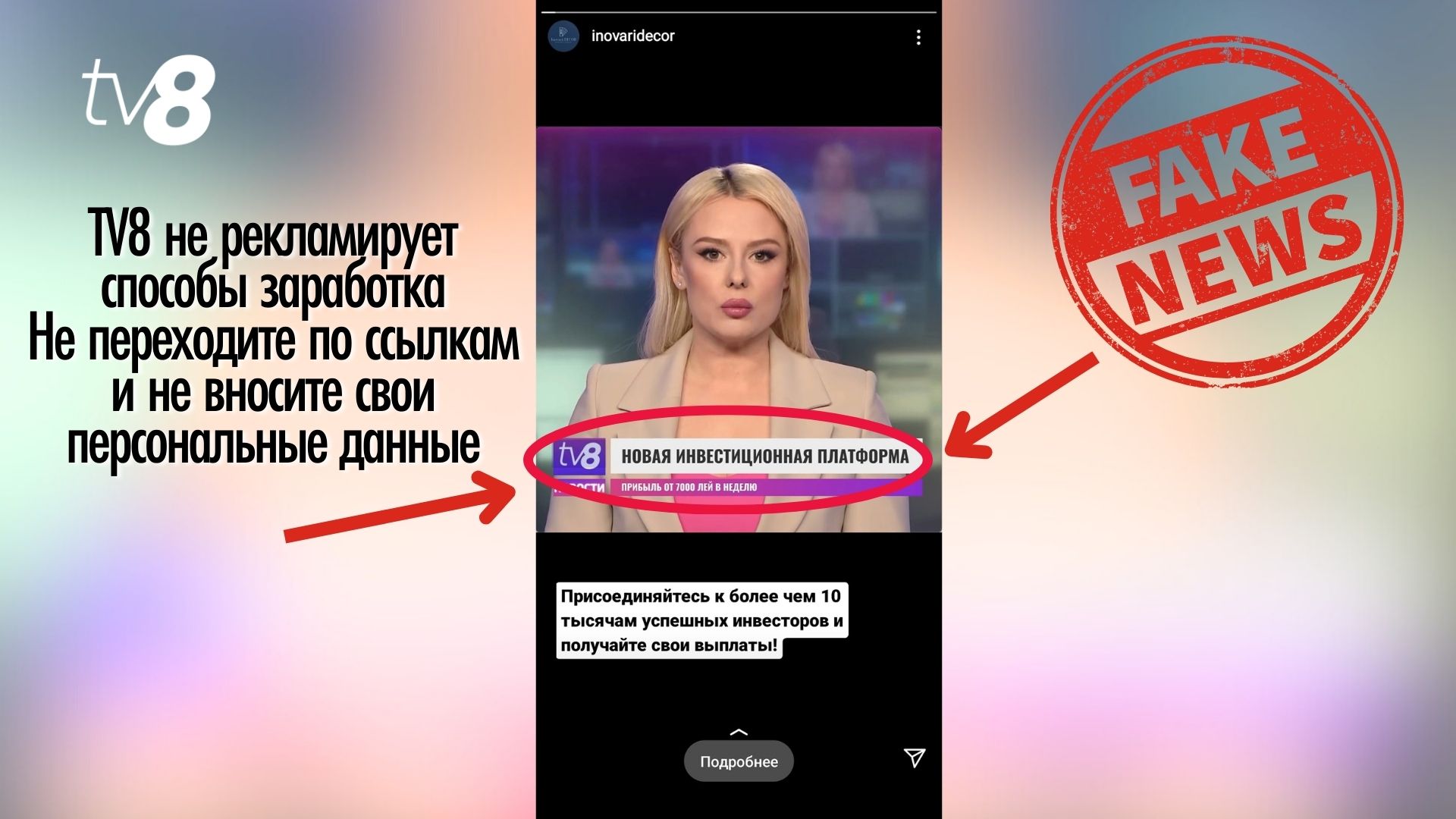

Финансовые мошенники, обещающие быстрый заработок с минимальными рисками, активно используют deepfake. Они создают видео, в которых известные личности — от государственных чиновников до телеведущих — якобы продвигают инвестиционные платформы, поддерживаемые государством с "гарантированной прибылью" и "защитой инвестиций". Для пущей убедительности в таких роликах часто используются логотипы известных телеканалов или банков, а также государственных учреждений.

Как защититься от цифровых мошенников?

Чтобы не стать жертвой обмана, следуйте этим рекомендациям:

- Избегайте подозрительных ссылок. Не переходите по ссылкам из непроверенных источников, не заполняйте анкеты, опросники или какие-либо формы, где требуется ввести личные данные.

- Не доверяйте обещаниям быстрого обогащения. Будьте осторожны со всеми, кто предлагает быстрый и лёгкий заработок в интернете.

- Проверяйте информацию. Используйте только официальные источники для подтверждения данных.

- Развивайте критическое мышление. Нужно понимать, что мы уже живем в мире, где голоса и образы людей могут быть подделаны, сомнения — это ваш лучший щит в ситуациях, когда вам предлагают что-то сенсационное.

***

Дипфейки — это подделанные аудио, визуальные или текстовые материалы, созданные с помощью генеративного ИИ. Злоумышленники используют их для шантажа, мошенничества, распространения дезинформации и других преступных целей. По мере совершенствования технологий дипфейки становятся всё более реалистичными, а задача их распознавания — всё сложнее. На "глаз" их уже крайне сложно отличать, а доступ к специальным программам распознавания и навыкам работы с ними есть у малого количества профессионалов.